J’ai ressuscité mon TuxDroid avec une IA locale : retour d’un gadget oublié devenu assistant intelligent

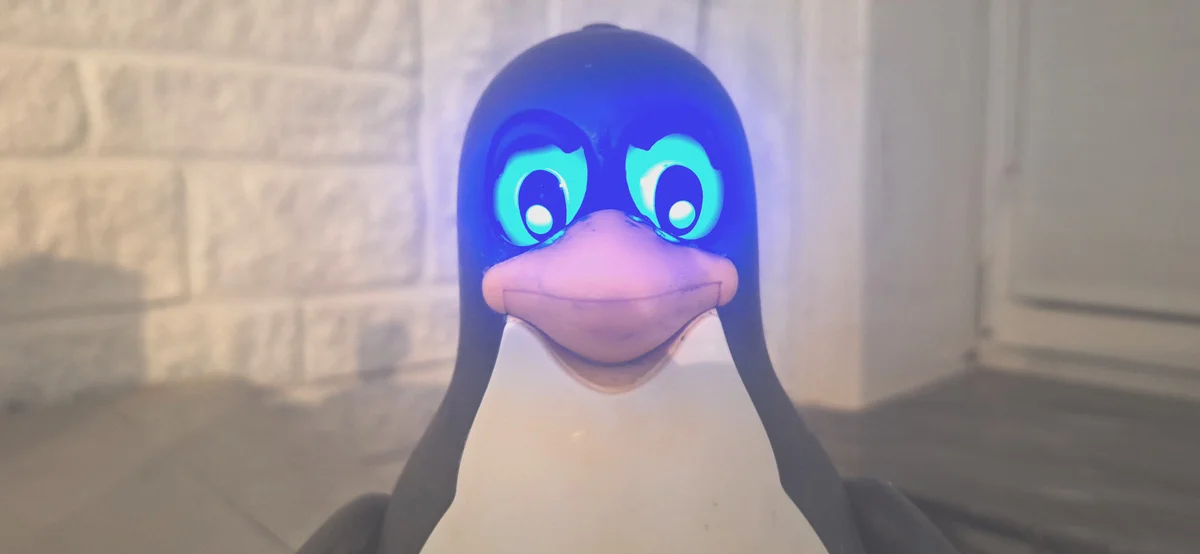

Il y a des objets qui marquent une époque. Le TuxDroid en fait clairement partie. Ce petit pingouin USB qui parlait, bougeait et clignait des yeux avait tout pour plaire… sauf une chose essentielle : il était complètement limité par son époque. Dépendant de logiciels abandonnés et d’un écosystème fermé, il finissait souvent au fond d’un tiroir après quelques jours d’utilisation.

Et pourtant, en 2026, ce genre de matériel peut revenir à la vie d’une manière totalement inattendue. Pas comme un simple gadget nostalgique, mais comme un vrai assistant intelligent, capable d’écouter, comprendre, répondre et interagir de manière fluide.

C’est exactement ce que j’ai fait avec TuxGPT.

Donner un cerveau moderne à un robot du passé

L’idée de base était simple : garder le hardware du TuxDroid, mais remplacer complètement son “cerveau”. Là où il dépendait autrefois de scripts rigides et limités, il repose aujourd’hui sur une architecture moderne combinant reconnaissance vocale, synthèse vocale et intelligence artificielle.

Le projet s’appuie sur un moteur vocal en Python, une interface graphique en Qt, et un contrôle matériel via Java pour piloter directement le robot.

L’objectif n’est pas juste de faire parler le Tux. C’est de lui donner un comportement cohérent, avec des états, des réactions et une logique conversationnelle. En d’autres termes, transformer un gadget en assistant.

Une IA hybride : local quand il faut, cloud quand c’est utile

L’un des points les plus intéressants du projet, c’est son fonctionnement hybride. Le Tux peut utiliser des services cloud comme OpenAI, mais il peut aussi fonctionner entièrement en local.

Et c’est là que ça devient vraiment intéressant techniquement.

Pour la version locale, j’utilise une stack composée d’Ollama pour le modèle de langage, whisper.cpp pour la reconnaissance vocale et Piper pour la synthèse vocale.

Le résultat est assez bluffant : un assistant capable de comprendre et répondre sans dépendre d’un serveur distant. La latence est faible, la confidentialité est totale, et l’expérience est beaucoup plus fluide que ce qu’on pourrait imaginer.

On a vraiment l’impression d’avoir une IA “dans” le robot.

Le vrai défi : synchroniser la voix et le mouvement

Là où le projet devient vraiment fun, c’est dans la gestion du matériel. Parce que le TuxDroid, ce n’est pas juste un haut-parleur. Il a un bec, des yeux, des ailes et des LEDs, et tout ça doit être synchronisé avec ce qu’il fait.

Le contrôle passe par ScayTux, un projet Java qui permet d’interagir avec le robot via USB. Une fois correctement configuré, on peut déclencher des actions précises : ouvrir le bec pendant la parole, faire cligner les yeux, changer la couleur des LEDs selon l’état…

Et c’est exactement ce qui donne vie au Tux. Il ne se contente pas de répondre, il réagit. Il écoute, réfléchit, parle… et ça se voit.

Une vraie logique conversationnelle

Le Tux ne fonctionne pas comme un simple bouton “question → réponse”. Il intègre une vraie logique d’assistant vocal. Détection de mot-clé, écoute continue, suivi conversationnel… il est capable d’enchaîner les interactions de manière naturelle.

Il peut même adapter son comportement, avec un mode enfant plus doux et des fonctionnalités comme la narration d’histoires.

Ce genre de détail change complètement la perception du projet. On ne parle plus à un script. On interagit avec quelque chose qui semble vivant.

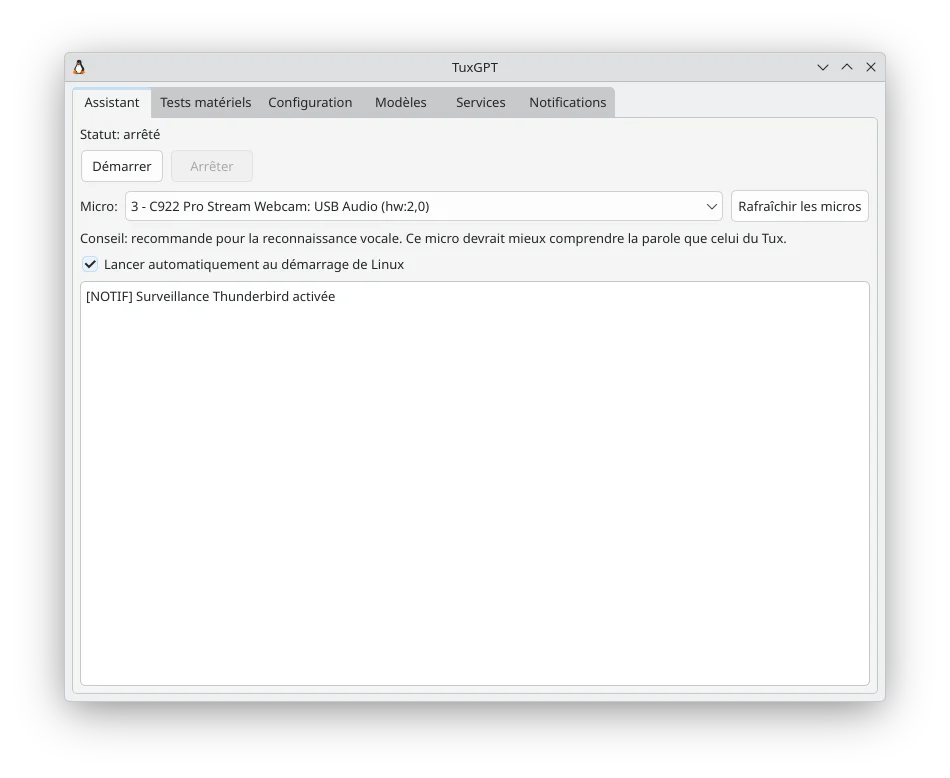

Une interface graphique pour tout piloter facilement

Pour rendre le projet plus accessible, j’ai ajouté une interface graphique basée sur PySide6. Elle permet de configurer les différents modules, tester le matériel, choisir les périphériques audio et ajuster les paramètres.

Ce n’est pas indispensable, mais ça améliore énormément l’expérience. Surtout quand tu veux tester rapidement un comportement ou ajuster un réglage sans replonger dans le code.

Ce projet m’a surpris sur un point précis

Au départ, c’était une bidouille. Un projet perso, presque nostalgique. Mais très vite, une évidence s’est imposée : ça fonctionne mieux que prévu.

La reconnaissance vocale est fiable, la synthèse vocale est naturelle, et surtout, l’ensemble est cohérent. Le Tux ne donne pas l’impression d’être une succession de scripts. Il donne l’impression d’avoir un comportement.

Et c’est là que le projet prend une autre dimension.

Et maintenant, le vrai potentiel commence

Le projet est déjà fonctionnel, mais il reste énormément de possibilités. Connecter les boutons physiques du Tux pour déclencher des actions, intégrer des services externes, ajouter de la domotique, enrichir les interactions…

Le TuxDroid devient une plateforme.

Et c’est probablement la partie la plus excitante.

Un vieux pingouin… et une vraie leçon de tech

Ce projet montre quelque chose d’assez simple, mais qu’on oublie souvent : le hardware ne meurt pas. Il devient juste obsolète… jusqu’à ce qu’on lui donne un nouveau rôle.

Avec les outils actuels, même un robot vieux de 20 ans peut devenir un assistant moderne, local, intelligent et interactif.

Et franchement, voir un TuxDroid discuter avec une IA en 2026…

C’est exactement le genre de truc qui rappelle pourquoi on aime bidouiller.

Commentaires

Réagis à l’article directement ici.